TEORIAS E FILOSOFIAS DE GRACELI 111

- Gerar link

- X

- Outros aplicativos

Leis de Ohm NO SISTEMA CATEGORIAL GRACELI.

sábado, 10 de novembro de 2018

A Interpretação da Função de Onda de Schrödinger no sistema categorial Graceli.

[pitG] = POTENCIAL DE INTERAÇÕES E TRANSFORMAÇÕES GRACELI.

=

=

exp [- (i/

exp [- (i/ ) E t],

) E t],

=

=  -

-

foi apresentada pelo próprio Schrödinger, ao interpretar os elétrons como pacotes de onda deslocando-se no espaço como se fossem partículas clássicas. Essa tentativa malogrou, pois logo ficou demonstrado que o “pacote” abria no decorre do tempo [ver qualquer texto sobre Mecânica Quântica, como, por exemplo: A. S. Davydov, Quantum Mechanics (Pergamon Press, 1965)]. De outra feita, ainda Schrödingerpropôs que seu campo escalar poderia medir a espessura da camada formada pelo elétron “espraiado” ou “derramado”, sem, no entanto, obter êxito. A interpretação que hoje é aceita foi a formulada pelo físico alemão Max Born (1882-1970; PNF, 1954), também em 1926 (Zeitschrift für Physik 37; 38, p. 863; 803), que a considerou como uma amplitude de probabilidade. Vejamos como ele chegou a essa interpretação.

foi apresentada pelo próprio Schrödinger, ao interpretar os elétrons como pacotes de onda deslocando-se no espaço como se fossem partículas clássicas. Essa tentativa malogrou, pois logo ficou demonstrado que o “pacote” abria no decorre do tempo [ver qualquer texto sobre Mecânica Quântica, como, por exemplo: A. S. Davydov, Quantum Mechanics (Pergamon Press, 1965)]. De outra feita, ainda Schrödingerpropôs que seu campo escalar poderia medir a espessura da camada formada pelo elétron “espraiado” ou “derramado”, sem, no entanto, obter êxito. A interpretação que hoje é aceita foi a formulada pelo físico alemão Max Born (1882-1970; PNF, 1954), também em 1926 (Zeitschrift für Physik 37; 38, p. 863; 803), que a considerou como uma amplitude de probabilidade. Vejamos como ele chegou a essa interpretação.

Nessa época, Born discutiu sua ideia com um jovem físico norte-americano Julius Robert Oppenheimer (1904-1967), explicando-lhe que baseou sua hipótese nos fenômenos físicos de dispersão, pois, ao estudar a dispersão de elétrons (representado por uma onda deBroglieana) por um átomo, verificou que o número de elétrons difundidos poderia ser calculado por intermédio de uma certa expressão quadrática, construída a partir da amplitude da onda esférica secundária, onda essa gerada pelo átomo espalhador do feixe eletrônico incidente. Hoje, essa expressão quadrática - =

=  - é denominada de probabilidade de encontrar o elétron em uma posição (

- é denominada de probabilidade de encontrar o elétron em uma posição ( ) estacionária. É oportuno destacar que Born e Oppenheimer, em 1927 (Annalender Physik 84, p. 457), desenvolveram o célebre Método de Born-Oppenheimer para estudar, quanticamente, os espectros eletrônico, vibracional e rotacional das moléculas.

) estacionária. É oportuno destacar que Born e Oppenheimer, em 1927 (Annalender Physik 84, p. 457), desenvolveram o célebre Método de Born-Oppenheimer para estudar, quanticamente, os espectros eletrônico, vibracional e rotacional das moléculas.

A essa interpretação de Born sobrepôs-se uma outra relevante questão. Será sempre possível observar uma grandeza física? A resposta a essa pergunta foi dada pelo físico alemão Werner Karl Heisenberg (1901-1976; PNF, 1932), ao apresentar, em 1927 (Zeitschrift für Physik 43, p. 172), o seu famoso Princípio da Incerteza: É impossível obter exatamente os valores simultâneos de duas variáveis, a não ser dentro de um limite mínimo de exatidão. Para o caso em que essas duas variáveis sejam (px) (componente do momento linear na direção x) e essa posição (x), aquele princípio apresenta a seguinte forma: <x2> <p2x> = (1/4) , com < > significando o valor médio.

, com < > significando o valor médio.

[pitG] = POTENCIAL DE INTERAÇÕES E TRANSFORMAÇÕES GRACELI.

matriz categorial Graceli.

T l T l E l Fl dfG l

N l El tf l

P l Ml tfefel

Ta l Rl

Ll

Dl

x

T l T l E l Fl dfG l

N l El tf l

P l Ml tfefel

Ta l Rl

Ll

Dl

nestes termos temos uma função de ondas num sistema dinâmico, transcendente, indeterminado e categorial, ou seja, varia, existe e se comporta como e em função das categorias de Graceli.

o mesmo se encaixa para átomo estático de Bohr.

x

T l T l E l Fl dfG l

N l El tf l

P l Ml tfefel

Ta l Rl

Ll

Dl

x

T l T l E l Fl dfG l

N l El tf l

P l Ml tfefel

Ta l Rl

Ll

Dl

A Interpretação da Função de Onda de Schrödinger.

Em verbetes desta série, vimos que o físico austríaco Erwin Schrödinger (1887-1961; PNF, 1933), em vários artigos escritos em 1926 (Annales de Physique Leipzig 79, p. 361; 489; 734; 747; 80, p. 437; e 81, p. 136), desenvolveu a hoje conhecida Mecânica Quântica Ondulatória, traduzida pela Equação de Schrödinger (ES):

onde  é a função de onda de Schrödinger ou campo escalar,

é a função de onda de Schrödinger ou campo escalar,  é o operador laplaciano,

é o operador laplaciano, é o operador Hamiltoniano,

é o operador Hamiltoniano,  é um dado potencial e

é um dado potencial e  = h/2

= h/2 , sendo h a constante de Planck.

, sendo h a constante de Planck.

Depois da proposta dessa equação, procurou-se saber o significado de  , pois, sendo a ES uma equação de onda, surgiu a seguinte questão. Ora, toda onda tem um suporte no qual ela se propaga: a onda sonora, é o ar; a onda elástica, é o meio material; e a onda eletromagnética, é o vácuo. Por outro lado, a sua solução geral envolve uma função complexa, ou seja:

, pois, sendo a ES uma equação de onda, surgiu a seguinte questão. Ora, toda onda tem um suporte no qual ela se propaga: a onda sonora, é o ar; a onda elástica, é o meio material; e a onda eletromagnética, é o vácuo. Por outro lado, a sua solução geral envolve uma função complexa, ou seja:  =

=

exp [- (i/

exp [- (i/ ) E t], solução essa chamada de estacionária, porque a energia (E) é bem definida.

) E t], solução essa chamada de estacionária, porque a energia (E) é bem definida.

A primeira tentativa de dar uma interpretação para a Nessa época, Born discutiu sua ideia com um jovem físico norte-americano Julius Robert Oppenheimer (1904-1967), explicando-lhe que baseou sua hipótese nos fenômenos físicos de dispersão, pois, ao estudar a dispersão de elétrons (representado por uma onda deBroglieana) por um átomo, verificou que o número de elétrons difundidos poderia ser calculado por intermédio de uma certa expressão quadrática, construída a partir da amplitude da onda esférica secundária, onda essa gerada pelo átomo espalhador do feixe eletrônico incidente. Hoje, essa expressão quadrática -

A essa interpretação de Born sobrepôs-se uma outra relevante questão. Será sempre possível observar uma grandeza física? A resposta a essa pergunta foi dada pelo físico alemão Werner Karl Heisenberg (1901-1976; PNF, 1932), ao apresentar, em 1927 (Zeitschrift für Physik 43, p. 172), o seu famoso Princípio da Incerteza: É impossível obter exatamente os valores simultâneos de duas variáveis, a não ser dentro de um limite mínimo de exatidão. Para o caso em que essas duas variáveis sejam (px) (componente do momento linear na direção x) e essa posição (x), aquele princípio apresenta a seguinte forma: <x2> <p2x> = (1/4)

É interessante ressaltar que a interpretação probabilística de Born e o Princípio da Incerteza de Heisenberg, levaram à interpretação da Mecânica Quântica pela Escola de Copenhague, sob a liderança do físico dinamarquês Niels Henrik David Bohr (1885-1962; PNF, 1922). Tal interpretação – a famosa Interpretação de Copenhague – ainda hoje é polêmica no mundo científico, por ser considerada uma interpretação idealista (Davydov, op. cit.). Mais detalhes sobre essa polêmica, ver: Gennaro Auletta, Foundations and Interpretation of Quantum Mechanics: In the Light of a Critical-Historical Analysis of the Problems and of a Synthesis of the Results (World Scientific, 2001).

[pitG] = POTENCIAL DE INTERAÇÕES E TRANSFORMAÇÕES GRACELI.

T l T l E l Fl dfG l

N l El tf l

P l Ml tfefel

Ta l Rl

Ll

Dl

X = k w (a/ ), [pitG]

), [pitG]

X

T l T l E l Fl dfG l

N l El tf l

P l Ml tfefel

Ta l Rl

Ll

Dl

S = k w (a/ ) = X = I. [pitG]

) = X = I. [pitG]

X

T l T l E l Fl dfG l

N l El tf l

P l Ml tfefel

Ta l Rl

Ll

Dl

V = (1/g) (L/A) I.[pitG]

X

T l T l E l Fl dfG l

N l El tf l

P l Ml tfefel

Ta l Rl

Ll

Dl

I = E/(R + r),[pitG]

X

T l T l E l Fl dfG l

N l El tf l

P l Ml tfefel

Ta l Rl

Ll

Dl

Leis de Ohm. O físico alemão Georg Simon Ohm (1787-1854) ao tomar conhecimento do livro ThéorieAnalytique de Apesar da publicação do trabalho de Ohm no Annalen, o editor dessa Revista, o físico alemão Johann Christian Poggendorff (1796-1877), fez-lhe uma sugestão. Com efeito, nesse trabalho, Ohm afirmara que a diminuição da “perda de força” era devida a uma possível variação na solução salina da pilha “hidroelétrica” que usura. Poggendorff, Em dezembro de 1825, Ohm começou a realizar novas experiências com circuitos elétricos, usando um termopar de cobre (Cu) – bismuto (Bi) em lugar da pilha voltaica que usara antes. Desse modo, na primeira metade de 1826, Ohm publicou quatro importantes artigos que tratavam de novos aspectos de sua teoria da eletricidade galvânica. No primeiro deles (Journal fürChemie und Physik 46, p. 137), procurou determinar uma relação entre a força eletromagnética da corrente e o comprimento total do fio de ligação. Assim, depois de uma série de experimentos, Ohm observou que os dados de cada série podiam ser descritos pela expressão: X = a/(b + x), onde X é a intensidade do efeito eletromagnético – que tomou como sendo I – de um condutor de comprimento x sobre a agulha magnética de uma balança de torção de Coulomb, e onde a e b são constantes cuja natureza exata ele se propôs a determinar por meio de outros experimentos. Além disso, ao observar que b permanecia constante em todas as séries de experimentos, e que a variava com a temperatura, levou Ohm a concluir que a só dependia da força eletromotriz [“erregende Kraft”] da pilha termoelétrica e b só da resistência [“Leitungswiderstand” (resistência de condução) ou “Widerstandlänge” (comprimento de resistência)] da porção restante do circuito, em particular a da própria pilha. Observou, ainda, que a força eletromotriz da pilha parecia ser proporcional à diferença de temperatura nas extremidades. Essas observações podem ser resumidas pela seguinte lei: - A força eletromotriz (E) atuando entre as extremidades de qualquer parte de um circuito é o produto da intensidade da corrente (I) e da resistência (R) daquela parte do circuito: E = RI. Esclareça-se que Ohm introduziu o conceito de força eletromotriz para substituir e aclarar a ideia de tensão que o cientista e estadista norte-americano Benjamin Franklin (1706-1790) havia conceituado em seus trabalhos sobre fluido elétrico, realizados entre 1747 e 1749 (vide verbete nesta série e Caneva, op. cit.; Lucie, op. cit.) Nos outros três artigos (Annalen der Physik und Chemie 6, p. 459; 7, p. 45; 117), Ohm desenvolveu uma ampla teoria da eletricidade galvânica baseada no fato de que o contato de corpos heterogêneos produzia e mantinha uma tensão (“Spannung”) constante. Como resultado de seus experimentos, Ohm apresentou a seguinte expressão: X = k w (a/ onde X é a intensidade da corrente elétrica (I), conforme vimos acima, k, w e É interessante registrar que Ohm media a tensão de uma pilha conectando um terminal a terra e o outro terminal a um eletroscópio. Quando ele queria saber as condições elétricas de um dado corpo A, ele o deslocava em relação a um eletroscópio, que era então atraído ou repelido pelo corpo eletrizado, por intermédio de uma “força eletroscópica”, como ele a denominou. [Sir Edmund Whittaker, A History of the Theories Aether and Electricity: The Classical Theories (Thomas Nelson and Sons Ltd., 1951).] Na continuação de seus trabalhos sobre uma teoria matemática da eletricidade galvânica, Ohm observou que a quantidade de carga elétrica (S) que passa através de uma dada secção reta (w) de um condutor de condutibilidade (k) na unidade de tempo, é dada pela expressão: S = k w du/dx, onde u é a “força eletroscópica” em um ponto variável x do condutor. Como também demonstrou que du = (a/ S = k w (a/ Registre-se que Ohm reuniu os resultados de seus trabalhos sobre a matemática da eletricidade galvânica em um livro intitulado Die Galvanische Kette Mathematisch Bearbeitet (“O Circuito Galvânico Matematicamente Analisado”), publicado em 1827. Nesse livro, além dos resultados obtidos em 1825 e 1826, Ohm descreveu novas experiências nas quais estudou a condutividade dos condutores, assim como as relações entre correntes e resistências associadas em série e em paralelo, e suas famosas leis. Antes de apresentar as leis de Ohm em sua forma moderna, é oportuno destacar que Ohm usou o conceito de tensão elétrica e não o de potencial eletrostático, que só foi definido pelo matemático inglês George Green (1793-1841), em 1828, em uma brochura, de divulgação privada, intitulada An Essay on the Application of Mathematical Analysis to the Theories ofElectricity and Magnetism (“Um Ensaio sobre a Aplicação da Análise Matemática às Teorias da Eletricidade e do Magnetismo”). Aliás, o conceito geral de função potencial (V) já havia sido apresentado pelo matemático e astrônomo Pierre Simon, Marquês de Laplace (1749-1827), no primeiro volume de sua Mécanique Celeste (“Mecânica Celeste”), publicado em 1799, função essa que satisfaz a célebre equação de Laplace: Agora, vejamos as leis de Ohm na linguagem atual, envolvendo valores constantes. Para um condutor de comprimento (L), de secção reta (A) e condutividade (g), a diferença de potencial (V) entre seus extremos é dada por: V = E L, onde E é a intensidade do campo elétrico ( S = k w (a/ transforma-se na equação: I = g A (V/L) Esta é a famosa lei de Ohm. Ela, no entanto, pode ser assim escrita: V = (1/g) (L/A) I. Definindo-se: Por fim, registre-se que as descobertas de Ohm foram bastante estudadas por vários pesquisadores, como, por exemplo, pelo físico e filósofo alemão Gustav Theodor Fechner (1801-1887) – um dos principais pesquisadores da psicofísica – em seu livro intitulado Maassbestimmumgen über die Galvanische Kette (“Determinação da Massa do Circuito Galvânico”), em 1831. Por sua vez, em 1833/1834 (Mémoires de l´Académie Impériale desSciences de Saint-Petersbourg 2, p. 427; Annalen der Physik und Chemie 31, p. 483), o físico germano-russo Heinrich Friedrich Emil Lenz (1804-1865), descobriu que a resistência de um fio metálico cresce quando aumenta a sua temperatura. As leis de Ohm foram redescobertas pelo físico francês Claude Servais Mathias Pouillet (1790-1868), em 1839, ao realizar experiências com circuitos elétricos, nas quais usou novas técnicas, envolvendo galvanômetros do tipo “tangente” e “seno”, que lhe permitiram medir correntes elétricas fracas. Por essa razão, o cálculo da corrente elétrica (I) em um circuito de resistência elétrica externa (R),.que é alimentado por um gerador de força eletromotriz (E) e resistência interna (r), dada pela expressão: I = E/(R + r), é também conhecida como lei de Ohm-Pouillet. (René Taton, IN: Dictionary of Scientific Biography, op. cit.) Por fim, é ainda oportuno registrar que o físico inglês Sir Charles Wheatstone (1802-1875), em 1843 (Philosophical Transactions of the Royal Society of London 133, p. 303), apresentou a verificação experimental da lei de Ohm e, desse modo, tornou-a conhecida na Inglaterra. Para essa verificação, desenvolveu novos modos de medir resistências e correntes elétricas, com um dispositivo hoje conhecido como ponte de Wheatstone. (Sigalia Dostrovsky, IN:Dictionary of Scientific Biography, op. cit.) A cor do céu: Einstein versus Smoluchowski. no sistema categorial Graceliterça-feira, 23 de outubro de 2018matriz do sistema categorial Graceli no

T l T l E l Fl dfG l N l El tf l P l Ml tfefel Ta l Rl Ll Dl Tipos, níveis, potenciais, tempo de ação, temperatura, eletricidade, magnetismo, radioatividade, luminescências, dinâmicas, estruturas, fenômenos, transições de fenômenos e estados físicos, e estados de energias, dimensões fenomênicas de Graceli. T l T l E l Fl dfG l N l El tf l P l Ml tfefel Ta l Rl Ll Dl Efeito Kerr (Efeito Eletro-Óptico) e Efeito Pockels (Efeito Eletro-Óptico Linear). Em 1875 (Philosophical Magazine 50, p. 337), o físico escocês John Kerr (1824-1907) observou que o vidro tornara-se birrefringente sob a ação de um intenso campo elétrico. Com efeito, ele tomou um pedaço de vidro de duas polegadas de espessura e fez dois buracos em suas extremidades, nos quais colocou dois eletrodos, aplicando neles um forte campo elétrico estático. Continuando com essas experiências relacionadas com esse efeito eletro-óptico, Kerr observou que a dupla refração induzida pelo campo elétrico era muito mais forte no nitrobenzeno (C6H5NO2) líquido do que no vidro. Nessas experiências, Kerr encontrou que o tamanho do efeito era proporcional ao quadrado do campo elétrico [B. S. Finn, IN: Dictionary of Scientific Biography (Charles Scribner´s Sons, 1981)]. Na linguagem atual, esse efeito é traduzido pela seguinte expressão: É oportuno destacar que, em 1876 [Philosophical Magazine 5, p. 321 (1877)] Kerr anunciou em uma reunião da British Association em Glasgow que um feixe de luz plano-polarizada havia se tornado elipticamente polarizado ao incidir no polo de um eletro-ímã. Observara, então, um novo aspecto do efeito magneto-óptico, efeito esse que já havia sido tratado pelo físico e químico inglês Michael Faraday (1791-1867), em 1845 (vide verbete nesta série). Destaque-se, também, que os efeitos observados por Kerr [eletro-óptico (Efeito Kerr) e magneto-óptico (Efeito Faraday)] foram estudados matematicamente pelo físico irlandês George Francis Fitzgerald (1851-1901), em 1880 (Philosophical Transactions of the Royal Society 171, p. 691). Em 1893, o físico alemão Friedrich Carl Alwin Pockels (1865-1913) descobriu que, em certos cristais que não possuem nenhum ponto central, cada átomo não pode refletir-se em um átomo idêntico. Esse Efeito Pockels (EP), contudo, é um efeito eletro-óptico linear, pois ele depende apenas da intensidade do campo elétrico E e não de seu quadrado, como no caso do Efeito Kerr (EK). É oportuno destacar que, tomando com base o EK e o EP, foram construídos células (``cells’’) e obturadores (``shutters’’) que são utilizados em experiências envolvendo a propagação da luz, principalmente na determinação de sua velocidade. [E. Hecht e A. Zajac, Optics (Addison-Wesley Publishing Company, 1979).] Em 1941 (Journal of the Optical Society of América 31, p. 286), o físico norte-americano Hans Mueller mostrou que o efeito observado por Kerr, em 1875, conforme vimos acima, é um milhão de vezes mais forte na bentonita (mistura de argilas) do que no nitrobenzeno líquido. [John Strong, Concepts of Classical Optics (W. H. Freeman and Company, 1958).] A cor do céu: Einstein versus Smoluchowski no sistema categorial Graceli. Matriz categorial de Graceli. T l T l E l Fl dfG l N l El tf l P l Ml tfefel Ta l Rl Ll Dl Tipos, níveis, potenciais, tempo de ação, temperatura, eletricidade, magnetismo, radioatividade, luminescências, dinâmicas, estruturas, fenômenos, transições de fenômenos e estados físicos, e estados de energias, dimensões fenomênicas de Graceli. trans-intermecânica de supercondutividade no sistema categorial de Graceli. EPG = d [hc] [T / IEEpei [pit] = [pTEMRLD] and [fao] [itd] [iicee] tetdvd [pe] cee [caG].] p it = potentials of interactions and transformations. Temperature divided by isotopes and physical states and potential states of energies and isotopes = emissions, random wave fluxes, ion interactions, charges and energies structures, tunnels and entanglements, transformations and decays, vibrations and dilations, electrostatic potential, conductivities, entropies and enthalpies. categories and agents of Graceli. h e = quantum index and speed of light. [pTEMRlD] = THERMAL, ELECTRICAL, MAGNETIC, RADIOACTIVE, Luminescence, DYNAMIC POTENTIAL] .. EPG = GRACELI POTENTIAL STATUS. [pTFE] = POTENCIAL DE TRANSIÇÕES DE FASES DE ESTADOS FÍSICOS E DE ENERGIAS E FANÔMENOS [TRANSIÇÕES DE GRACELI] , [pTEMRLD] [hc] [pI] [PF] [pIT][pTFE] [CG]. T l T l E l Fl dfG l N l El tf l P l Ml tfefel Ta l Rl Ll Dl T l T l E l Fl dfG l N l El tf l P l Ml tfefel Ta l Rl Ll Dl (TC), T l T l E l Fl dfG l N l El tf l P l Ml tfefel Ta l Rl Ll Dl

Subscrever: Mensagens (Atom) |

A cor do céu: Einstein versus Smoluchowski. no sistema categorial Graceli

terça-feira, 23 de outubro de 2018

matriz do sistema categorial Graceli no

= 2

= 2 B

B E2

E2

Efeito Kerr (Efeito Eletro-Óptico) |

T l T l E l Fl dfG l

N l El tf l

P l Ml tfefel

Ta l Rl

Ll

Dl

Tipos, níveis, potenciais, tempo de ação, temperatura, eletricidade, magnetismo, radioatividade, luminescências, dinâmicas, estruturas, fenômenos, transições de fenômenos e estados físicos, e estados de energias, dimensões fenomênicas de Graceli.

T l T l E l Fl dfG l

N l El tf l

P l Ml tfefel

Ta l Rl

Ll

Dl

Efeito Kerr (Efeito Eletro-Óptico) e Efeito Pockels (Efeito Eletro-Óptico Linear).

Em 1875 (Philosophical Magazine 50, p. 337), o físico escocês John Kerr (1824-1907) observou que o vidro tornara-se birrefringente sob a ação de um intenso campo elétrico. Com efeito, ele tomou um pedaço de vidro de duas polegadas de espessura e fez dois buracos em suas extremidades, nos quais colocou dois eletrodos, aplicando neles um forte campo elétrico estático. Continuando com essas experiências relacionadas com esse efeito eletro-óptico, Kerr observou que a dupla refração induzida pelo campo elétrico era muito mais forte no nitrobenzeno (C6H5NO2) líquido do que no vidro. Nessas experiências, Kerr encontrou que o tamanho do efeito era proporcional ao quadrado do campo elétrico [B. S. Finn, IN: Dictionary of Scientific Biography (Charles Scribner´s Sons, 1981)]. Na linguagem atual, esse efeito é traduzido pela seguinte expressão:

= 2

= 2 B

B E2, onde

E2, onde  é a diferença de fase entre os dois raios luminosos, B (também conhecido como K) é denominado coeficiente de Kerr, característica de cada material,

é a diferença de fase entre os dois raios luminosos, B (também conhecido como K) é denominado coeficiente de Kerr, característica de cada material,  é o comprimento do caminho óptico no meio, e E é a intensidade do campo elétrico estático.

é o comprimento do caminho óptico no meio, e E é a intensidade do campo elétrico estático.

É oportuno destacar que, em 1876 [Philosophical Magazine 5, p. 321 (1877)] Kerr anunciou em uma reunião da British Association em Glasgow que um feixe de luz plano-polarizada havia se tornado elipticamente polarizado ao incidir no polo de um eletro-ímã. Observara, então, um novo aspecto do efeito magneto-óptico, efeito esse que já havia sido tratado pelo físico e químico inglês Michael Faraday (1791-1867), em 1845 (vide verbete nesta série). Destaque-se, também, que os efeitos observados por Kerr [eletro-óptico (Efeito Kerr) e magneto-óptico (Efeito Faraday)] foram estudados matematicamente pelo físico irlandês George Francis Fitzgerald (1851-1901), em 1880 (Philosophical Transactions of the Royal Society 171, p. 691).

Em 1893, o físico alemão Friedrich Carl Alwin Pockels (1865-1913) descobriu que, em certos cristais que não possuem nenhum ponto central, cada átomo não pode refletir-se em um átomo idêntico. Esse Efeito Pockels (EP), contudo, é um efeito eletro-óptico linear, pois ele depende apenas da intensidade do campo elétrico E e não de seu quadrado, como no caso do Efeito Kerr (EK). É oportuno destacar que, tomando com base o EK e o EP, foram construídos células (``cells’’) e obturadores (``shutters’’) que são utilizados em experiências envolvendo a propagação da luz, principalmente na determinação de sua velocidade. [E. Hecht e A. Zajac, Optics (Addison-Wesley Publishing Company, 1979).]

Em 1941 (Journal of the Optical Society of América 31, p. 286), o físico norte-americano Hans Mueller mostrou que o efeito observado por Kerr, em 1875, conforme vimos acima, é um milhão de vezes mais forte na bentonita (mistura de argilas) do que no nitrobenzeno líquido. [John Strong, Concepts of Classical Optics (W. H. Freeman and Company, 1958).]

A cor do céu: Einstein versus Smoluchowski no sistema categorial Graceli.

,

,

.

.

Matriz categorial de Graceli.

T l T l E l Fl dfG l

N l El tf l

P l Ml tfefel

Ta l Rl

Ll

Dl

Tipos, níveis, potenciais, tempo de ação, temperatura, eletricidade, magnetismo, radioatividade, luminescências, dinâmicas, estruturas, fenômenos, transições de fenômenos e estados físicos, e estados de energias, dimensões fenomênicas de Graceli.

trans-intermecânica de supercondutividade no sistema categorial de Graceli.

EPG = d [hc] [T / IEEpei [pit] = [pTEMRLD] and [fao] [itd] [iicee] tetdvd [pe] cee [caG].]

p it = potentials of interactions and transformations.

Temperature divided by isotopes and physical states and potential states of energies and isotopes = emissions, random wave fluxes, ion interactions, charges and energies structures, tunnels and entanglements, transformations and decays, vibrations and dilations, electrostatic potential, conductivities, entropies and enthalpies. categories and agents of Graceli.

h e = quantum index and speed of light.

[pTEMRlD] = THERMAL, ELECTRICAL, MAGNETIC, RADIOACTIVE, Luminescence, DYNAMIC POTENTIAL] ..

EPG = GRACELI POTENTIAL STATUS.

[pTFE] = POTENCIAL DE TRANSIÇÕES DE FASES DE ESTADOS FÍSICOS E DE ENERGIAS E FANÔMENOS [TRANSIÇÕES DE GRACELI]

, [pTEMRLD] [hc] [pI] [PF] [pIT][pTFE] [CG].

EPG = d [hc] [T / IEEpei [pit] = [pTEMRLD] and [fao] [itd] [iicee] tetdvd [pe] cee [caG].]

p it = potentials of interactions and transformations.

Temperature divided by isotopes and physical states and potential states of energies and isotopes = emissions, random wave fluxes, ion interactions, charges and energies structures, tunnels and entanglements, transformations and decays, vibrations and dilations, electrostatic potential, conductivities, entropies and enthalpies. categories and agents of Graceli.

h e = quantum index and speed of light.

[pTEMRlD] = THERMAL, ELECTRICAL, MAGNETIC, RADIOACTIVE, Luminescence, DYNAMIC POTENTIAL] ..

EPG = GRACELI POTENTIAL STATUS.

[pTFE] = POTENCIAL DE TRANSIÇÕES DE FASES DE ESTADOS FÍSICOS E DE ENERGIAS E FANÔMENOS [TRANSIÇÕES DE GRACELI]

, [pTEMRLD] [hc] [pI] [PF] [pIT][pTFE] [CG].

T l T l E l Fl dfG l

N l El tf l

P l Ml tfefel

Ta l Rl

Ll

Dl

T l T l E l Fl dfG l

N l El tf l

P l Ml tfefel

Ta l Rl

Ll

Dl

(TC),  ],

],

T l T l E l Fl dfG l

N l El tf l

P l Ml tfefel

Ta l Rl

Ll

Dl

| A cor do céu: Einstein versus Smoluchowski. |

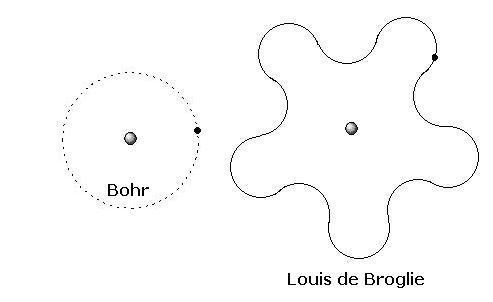

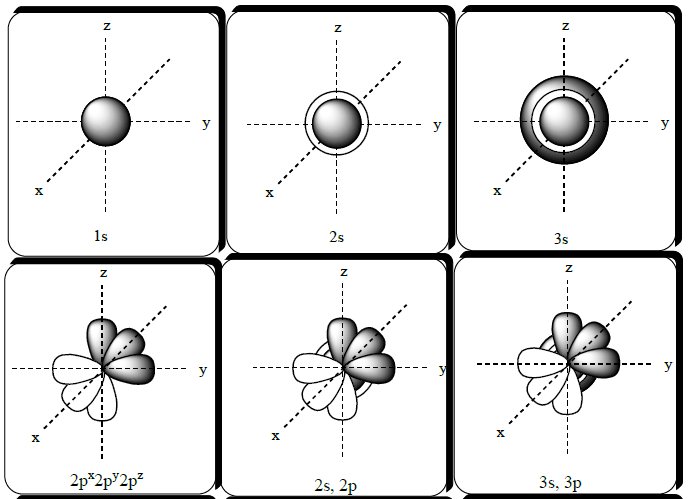

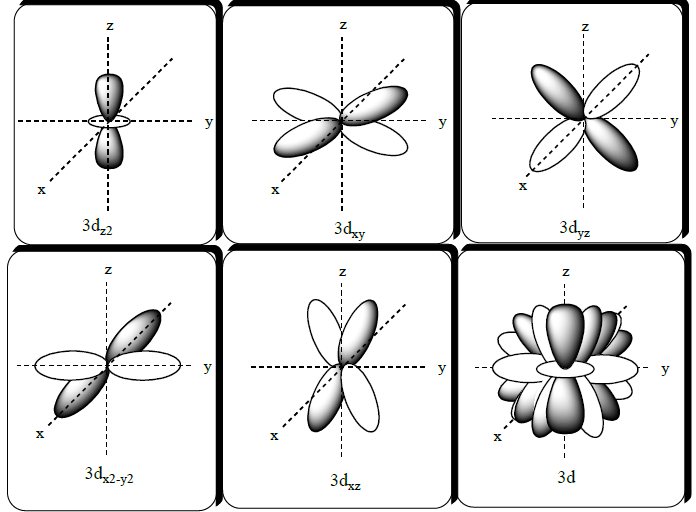

| Provavelmente, uma das mais antigas questões que intrigou o homem foi a razão do céu ser azul e, também, ser avermelhado o nascer e o por do Sol. Muitos cientistas tentaram explicá-los. O artista, inventor e cientista italiano Leonardo da Vinci (1452-1519), por volta de 1500, e o poeta e filósofo alemão Johann Wolfgang von Goethe (1749-1832), em torno de 1810, chegaram a observar certo azulamento na fumaça. Uma primeira explicação para tal percepção foi tentada pelo físico e matemático inglês Sir Isaac Newton (1642-1727), em seu livro Optics, publicado em 1704, ao atribuir os fenômenos de interferência (em primeira ordem), como sendo responsáveis pelo azul do céu. No entanto, tal explicação foi contestada pelo fisiologista alemão Ernst Wilhelm Brücke (1819-1892) - o introdutor dos métodos físicos e químicos na pesquisa em Medicina - ao observar que uma coloração azul nos hidrosóis (colóides solúveis na água) não poderia ser explicada como devido ao fenômeno de interferência em primeira ordem (como Newton havia suposto), já que esta ocorre em substâncias não-saturadas.O primeiro passo importante para a explicação do azul do céu foi dado pelo físico inglês John Tyndall (1820-1893), em 1869 [Philosophical Magazine 37(250); 38(253), pgs. 384; 156] e 1870 (Philosophical Transactions of Royal Society of London 160), ao estudar o espalhamento de um feixe de luz por um meio contendo pequenas partículas suspensas. Ele observou que uma sala cheia de fumaça ou de poeira torna visível um feixe de luz que, repentinamente, nela penetre. Ao notar um azulamento em um feixe de luz que atravessou um nevoeiro ("smog") formado por uma reação fotoquímica que estava realizando, escreveu em seu Caderno de Notas: Associo este azul com a cor do céu. A partir daí suas pesquisas sempre procuravam uma associação entre qualquer coloração azul em nevoeiros e a cor do céu. Essa observação de Tyndall, hoje conhecida como efeito Tyndall, fez com que o mundo científico o considere como o cientista que demonstrou a razão do azul do céu. Como a explicação dada por Tyndall sobre a cor azul do céu era apenas qualitativa, outros físicos procuraram uma explicação quantitativa desse fenômeno, o que foi imediatamente conseguida pelo físico inglês John William Strutt, Lord Rayleigh (1842-1919; PNF, 1904), em 1871 [Philosophical Magazine41(4), p. 107]. Em sua explicação, o descobridor do argônio (A), demonstrou que a intensidade (I) da luz espalhada por gases é proporcional à quarta potência da freqüência (n) da luz considerada [ou inversamente proporcional à quarta potência do comprimento de onda (l), pois ln = c, onde c é a velocidade da luz no vácuo], e assim, explicou de uma só vez a cor azul do céu e o vermelho do por e do nascer do Sol. Com efeito, como o azul tem uma das maiores freqüências das cores do espectro luminoso, a atmosfera terrestre espalha mais azul do que as demais cores do espectro luminoso. (Aqui cabe uma observação, pois a cor de maior freqüência daquele espectro é o violeta, porém, como nosso órgão visual á mais sensível ao azul do que ao violeta, vemos apenas o azul.) No caso do nascer e do por do Sol, sua cor avermelhada decorre do fato de que, nessas duas situações, os raios solares incidem tangencialmente à superfície de nosso planeta, então as cores de maior freqüência são bastante espalhadas para cima do horizonte ficando, deste modo, apenas a vermelha, que é a cor de menor freqüência do espectro luminoso.Rayleigh chegou ao resultado indicado acima usando a Análise Dimensional. Vejamos como. Partiu da hipótese de que a amplitude E da luz espalhada por uma molécula de ar a uma distância r desta, é proporcional à amplitude E0 da luz incidente, ao inverso de r, ao comprimento de onda l, a c e ao volume esférico (4pR3/3) da molécula de ar de raio r, ou seja: Vejamos mais alguns fatos relacionados com a explicação do azul do céu. Em 1874 (Annalen der Physik und Chemie 151, p. 306), M. Avenarius demonstrou que quando a luz branca passa por um vapor próximo de seu ponto crítico, há o aparecimento de uma opalescência azulada. Por sua vez, o físico e químico escocês Sir James Dewar (1842-1923; PNQ, 1904) - o inventor da garrafa térmica, em 20 de janeiro de 1893, e, também, o primeiro a liquefazer e a solidificar o hidrogênio (H), em 1898 e 1899, respectivamente -, ao descobrir a cor azul do oxigênio (O) líquido, afirmou que a cor azul do céu se devia à presença desse elemento químico na atmosfera. Em 1908 (Annalen der Physik 25, p. 205), o físico polonês Marian von Smolan-Smoluchowski (1872-1917), explicou a observação de Avenarius como sendo devida às flutuações da densidade do meio considerado e, com isso, o azul do céu. Em 1910 (Annalen der Physik 33, p. 1275), o físico germano-norte-americano Albert Einstein (1879-1955; PNF, 1921) estudou o espalhamento da luz de comprimento de onda l em um meio gasoso (de volume V, pressão P e temperatura absoluta T), ocasião em que demonstrou que: Cremos ser oportuno registrar que o cosmonauta soviético Yury Alekseyevich Gagarin (1934-1968), além de ser o primeiro homem colocado em órbita em torno da Terra, no dia 12 de abril de 1961, foi, também, o primeiro terrestre a ver o azul do céu, fora da Terra, pois, naquela ocasião, pronunciou a célebre frase: A Terra é azul! a Emissão Estimulada e o Princípio do Laser no sistema categorial Graceli.sexta-feira, 16 de novembro de 2018a Emissão Estimulada e o Princípio do Laser no sistema categorial Graceli. Matriz categorial de Graceli. T l T l E l Fl dfG l N l El tf l P l Ml tfefel Ta l Rl Ll Dl Tipos, níveis, potenciais, tempo de ação, temperatura, eletricidade, magnetismo, radioatividade, luminescências, dinâmicas, estruturas, fenômenos, transições de fenômenos e estados físicos, e estados de energias, dimensões fenomênicas de Graceli. trans-intermecânica de supercondutividade no sistema categorial de Graceli. EPG = d [hc] [T / IEEpei [pit] = [pTEMRLD] and [fao] [itd] [iicee] tetdvd [pe] cee [caG].] p it = potentials of interactions and transformations. Temperature divided by isotopes and physical states and potential states of energies and isotopes = emissions, random wave fluxes, ion interactions, charges and energies structures, tunnels and entanglements, transformations and decays, vibrations and dilations, electrostatic potential, conductivities, entropies and enthalpies. categories and agents of Graceli. h e = quantum index and speed of light. [pTEMRlD] = THERMAL, ELECTRICAL, MAGNETIC, RADIOACTIVE, Luminescence, DYNAMIC POTENTIAL] .. EPG = GRACELI POTENTIAL STATUS. [pTFE] = POTENCIAL DE TRANSIÇÕES DE FASES DE ESTADOS FÍSICOS E DE ENERGIAS E FANÔMENOS [TRANSIÇÕES DE GRACELI] , [pTEMRLD] [hc] [pI] [PF] [pIT][pTFE] [CG]. I( X T l T l E l Fl dfG l N l El tf l P l Ml tfefel Ta l Rl Ll Dl I ( X T l T l E l Fl dfG l N l El tf l P l Ml tfefel Ta l Rl Ll Dl I ( X T l T l E l Fl dfG l N l El tf l P l Ml tfefel Ta l Rl Ll Dl X T l T l E l Fl dfG l N l El tf l P l Ml tfefel Ta l Rl Ll Dl Bmn = Bnm ; Amn = (8 X T l T l E l Fl dfG l N l El tf l P l Ml tfefel Ta l Rl Ll Dl X T l T l E l Fl dfG l N l El tf l P l Ml tfefel Ta l Rl Ll Dl a Emissão Estimulada e o Princípio do Laser. no final do Século I( onde Contudo, em junho de 1900 (Philosophical Magazine 49, p. 98; 539), o físico inglês John William Strutt, Lord Rayleigh (1842-1919; PNF, 1904) observou que ela só se aplicava a pequenos I ( conhecida como fórmula de Rayleigh. Por sua vez, usando argumentos físicos diferentes dos usados por Wien, ou seja, considerando a entropia dos osciladores harmônicos, o físico alemão Max Planck (1858-1847; PNF, 1918) re-obteve a fórmula de Wien-Paschen. No entanto, experiências realizadas pelos físicos alemães Heinrich Rubens (1865-1922) e Ferdinand Kurlbaum (1857-1927), em outubro de 1900 (Sitzungsberichte der Königlich Preussischen Akademie der Wissenschaften zu Berlin 25, p. 929), mostraram que essa expressão falhava quando I ( que se reduzia àquelas mesmas fórmulas, quando se fizesse Planck tentou deduzir teoricamente essa sua expressão usando todos os recursos da Termodinâmica até então conhecida. No entanto, como não encontrou nenhum erro nos cálculos de Rayleigh, Planck utilizou então a interpretação probabilística proposta pelo físico austríaco Ludwig Boltzmann (1844-1906), em 1877 (Sitzungsberichte der Kaiserlichen Akademie der Wissenschaften zuWien 75; 76, p. 373; 62), para o cálculo da entropia dos osciladores moleculares, de frequência Em 1916 (Verhandlungen der Deutschen Physikalischen Gesellschaft 18, p. 318; Mitteilungender Physikalischen Gesellschaft zur Zürich 16, p. 47) e 1917 (Physikalische Zeitschrift 18, p. 121), o físico germano-suíço-norte-americano Albert Einstein (1879-1955; PNF, 1922) realizou trabalhos nos quais tratou a radiação eletromagnética sob o ponto de vista mecânico-estatístico. Nesses trabalhos, ele examinou um corpo negro em equilíbrio térmico contendo, além da radiação, átomos simples com apenas dois níveis de energia (En, Em), sendo que a passagem de um nível para o outro seria por intermédio da emissão (m Bmn = Bnm ; Amn = (8 Einstein demonstrou a hoje conhecida equação de Planck-Einstein: com k sendo a constante de Boltzmann. Este era um resultado teórico em busca de uma aplicação prática, que somente aconteceu na década de 1950 (ver verbete nesta série). [Abraham Pais, ‘Subtle is the Lord... The Science and the Life of Albert Einstein (Oxford University Press, 1983)]. modelo atõmico de Graceli.quarta-feira, 31 de outubro de 2018the atomic model of Graceli. is based on types of structures [waves and particles], potential transitions of states, energies, phenomena, phenomenal dimensions of Graceli, and categories present in the Graceli categorical matrix. modelo atômico de Graceli. se fundamenta em tipos de estruturas [ondas e partículas], potenciais de transições de estados, energias, fenômenos, dimensões fenomênicas de Graceli, e categorias presentes na matriz categorial Graceli. Matriz categorial de Graceli. T l T l E l Fl dfG l N l El tf l P l Ml tfefel Ta l Rl Ll Dl Tipos, níveis, potenciais, tempo de ação [categorias de Graceli], temperatura, eletricidade, magnetismo, radioatividade, luminescências, dinâmicas, estruturas, fenômenos, transições de fenômenos e estados físicos, e estados de energias, dimensões fenomênicas de Graceli. trans-intermecânica de TUNELAMENTO no sistema categorial de Graceli. EPG = d [hc] [T / IEEpei [pit] = [pTEMRLD] and [fao] [itd] [iicee] tetdvd [pe] cee [caG].] p it = potentials of interactions and transformations. Temperature divided by isotopes and physical states and potential states of energies and isotopes = emissions, random wave fluxes, ion interactions, charges and energies structures, tunnels and entanglements, transformations and decays, vibrations and dilations, electrostatic potential, conductivities, entropies and enthalpies. categories and agents of Graceli. h e = quantum index and speed of light. [pTEMRlD] = THERMAL, ELECTRICAL, MAGNETIC, RADIOACTIVE, Luminescence, DYNAMIC POTENTIAL] .. EPG = GRACELI POTENTIAL STATUS. [pTFE] = POTENCIAL DE TRANSIÇÕES DE FASES DE ESTADOS FÍSICOS E DE ENERGIAS E FANÔMENOS [TRANSIÇÕES DE GRACELI] , [pTEMRLD] [hc] [pI] [PF] [pIT][pTFE] [CG].. Modelo atômico de SchrödingerLouis de Broglie, já em meados da década de 1920, propôs a extensão da dualidade “onda-partícula” ao elétron. Para Broglie, o elétron apresentava comportamento de partícula e de onda, e por este motivo elétrons poderiam apresentar propriedades da mecânica ondulatória. De Broglie postulara o enunciado de que “a todo elétron em movimento está associada uma onda característica”, admitindo este comportamento dualístico e chocando-se diretamente com as proposições anteriores, que afirmavam que o elétron descrevia órbitas circulares ao redor do núcleo. Esta afirmação foi bastante contestada pelos cientistas contemporâneos de Louis de Broglie, porém experimentos realizados à época comprovaram a tese de que elétrons poderiam apresentar e obedecer à preceitos das leis ondulatórias, como se fossem ondas luminosas. Seguindo este pressuposto, as órbitas defendidas por Bohr e Sommerfeld não poderiam corresponder à realidade, uma vez que o elétron descreveria o comportamento de uma onda ao redor do núcleo. A figura a seguir demonstra, de maneira bastante simples, como poderia ser descrita a órbita em forma de ondas ao redor do núcleo e o modelo anterior.  Eletrosferas distintas – Modelo de Bohr e a sugestão de Louis de Broglie Este fato trouxe uma nova perspectiva à questão, uma vez que não fazia sentido tentar descrever valores tão exatos dos elétrons. Como definir questões tão intrínsecas ao átomo? Utilizando-se dos conhecimentos da Mecânica ondulatória, diria Erwin Schrödinger. Erwin Schrödinger (*1887 – †1961) determinou, através de uma infinidade de operações matemáticas (cálculos e equações do movimento de ondas e plotagem dos dados em plano cartesiano), as regiões no espaço que apresentariam máxima probabilidade de se encontrar um elétron. A esta altura a utilização do termo órbita já estava em desuso, pois não se poderia prever, pelo princípio da incerteza de Heisenberg, a posição e velocidade de um elétron. Logo, determinou-se orbital a região que apresentaria máxima probabilidade de localização dos elétrons e, portanto, orbitais se assemelhariam, grosso modo, a nuvens eletrônicas. Schrödinger, ao propor o modelo de orbitais atômicos, conciliou os postulados teóricos de De Broglie e Heisenberg, formalizando a ideia de que o elétron apresenta comportamento dual (onda – partícula). O modelo atômico de Schrödinger apresentou um modelo de orbital tridimensional para cada um dos subníveis de energia e possibilitou a compreensão do fenômeno da hibridação em átomos de carbono, permitindo a determinação da geometria molecular de diversas substâncias químicas. A geometria molecular, por sua vez permite a previsão de propriedades físicas e químicas de diversos compostos. O modelo quântico ondulatório ou modelo de orbital obedece à dinâmica dos números quânticos (principal, secundário, magnético e de spin), tendo status de modelo vigente, e sendo válido desde 1923 até os dias atuais.   Quadro contendo representações de orbitais. Subscrever: Mensagens (Atom) teorema H de Boltzmann no sistema categorial Graceli.sexta-feira, 2 de novembro de 2018teorema H e categorias de Graceli Matriz categorial de Graceli. T l T l E l Fl dfG l N l El tf l P l Ml tfefel Ta l Rl Ll Dl Tipos, níveis, potenciais, tempo de ação [categorias de Graceli], temperatura, eletricidade, magnetismo, radioatividade, luminescências, dinâmicas, estruturas, fenômenos, transições de fenômenos e estados físicos, e estados de energias, dimensões fenomênicas de Graceli. trans-intermecânica de TUNELAMENTO no sistema categorial de Graceli. EPG = d [hc] [T / IEEpei [pit] = [pTEMRLD] and [fao] [itd] [iicee] tetdvd [pe] cee [caG].] p it = potentials of interactions and transformations. Temperature divided by isotopes and physical states and potential states of energies and isotopes = emissions, random wave fluxes, ion interactions, charges and energies structures, tunnels and entanglements, transformations and decays, vibrations and dilations, electrostatic potential, conductivities, entropies and enthalpies. categories and agents of Graceli. h e = quantum index and speed of light. [pTEMRlD] = THERMAL, ELECTRICAL, MAGNETIC, RADIOACTIVE, Luminescence, DYNAMIC POTENTIAL] .. EPG = GRACELI POTENTIAL STATUS. [pTFE] = POTENCIAL DE TRANSIÇÕES DE FASES DE ESTADOS FÍSICOS E DE ENERGIAS E FANÔMENOS [TRANSIÇÕES DE GRACELI] , [pTEMRLD] [hc] [pI] [PF] [pIT][pTFE] [CG]..  X T l T l E l Fl dfG l N l El tf l P l Ml tfefel Ta l Rl Ll Dl

teorema H e categorias de Graceli Matriz categorial de Graceli. T l T l E l Fl dfG l N l El tf l P l Ml tfefel Ta l Rl Ll Dl Tipos, níveis, potenciais, tempo de ação [categorias de Graceli], temperatura, eletricidade, magnetismo, radioatividade, luminescências, dinâmicas, estruturas, fenômenos, transições de fenômenos e estados físicos, e estados de energias, dimensões fenomênicas de Graceli. trans-intermecânica de TUNELAMENTO no sistema categorial de Graceli. EPG = d [hc] [T / IEEpei [pit] = [pTEMRLD] and [fao] [itd] [iicee] tetdvd [pe] cee [caG].] p it = potentials of interactions and transformations. Temperature divided by isotopes and physical states and potential states of energies and isotopes = emissions, random wave fluxes, ion interactions, charges and energies structures, tunnels and entanglements, transformations and decays, vibrations and dilations, electrostatic potential, conductivities, entropies and enthalpies. categories and agents of Graceli. h e = quantum index and speed of light. [pTEMRlD] = THERMAL, ELECTRICAL, MAGNETIC, RADIOACTIVE, Luminescence, DYNAMIC POTENTIAL] .. EPG = GRACELI POTENTIAL STATUS. [pTFE] = POTENCIAL DE TRANSIÇÕES DE FASES DE ESTADOS FÍSICOS E DE ENERGIAS E FANÔMENOS [TRANSIÇÕES DE GRACELI] , [pTEMRLD] [hc] [pI] [PF] [pIT][pTFE] [CG]..  X T l T l E l Fl dfG l N l El tf l P l Ml tfefel Ta l Rl Ll Dl

Subscrever: Mensagens (Atom) Subscrever: Mensagens (Atom) |

Subscrever: Mensagens (Atom)

Subscrever: Mensagens (Atom)

- Gerar link

- X

- Outros aplicativos

Comentários

Postar um comentário